ORLM-R1,推理新范式重塑大模型建模能力边界丨杉数新知

从数学推理到数学建模

大语言模型(LLMs)已经证明是优秀的数学家和奥数选手,通过可验证奖励强化学习(RLVR, reinforcement learning with verifiable reward)这类可提供即时、可验证反馈的自我迭代改进的训练方法,大语言模型在解决具有正确答案的传统数学问题(如AIME)方面表现得非常优异。

以最新版的DeepSeek-R1-0528模型为例,其在AIME 2025考试中获得了高达87.5%的正确率,相比其前代的70%准确率实现了巨大飞跃。这充分验证了大型推理模型(LRMs)与RLVR训练框架的显著优势——通过自我验证与渐进式推理优化,实现更精准的序列决策。

当我们将目光从上述经典数学类问题转移到常见的数学建模或运筹学建模问题上,我们很快就发现上述模型与经典的训练方式面临着新的挑战。

考虑一个典型的物流排班问题,它并非由单一公式决定,而是由数百个相互关联的变量和动态约束条件共同构建的巨大难题。对于该问题,我们需要在满足一系列严苛条件的前提下,找到一个最优的分配方案:

1、核心变量:包括员工 (E)、任务 (T)、时间 (H) 以及运输工具 (V)。决策变量可能是布尔型的,例如xe,t,h,v=1,表示员工 e 在 h 小时使用 v 完成任务 t,否则为0。

2、目标函数:通常是最小化成本(例如总工资、加班费、燃料消耗)或最大化效益(例如准时交付率、货物吞吐量)。

3、复杂约束:涵盖了所有现实世界的限制,如:

任务-员工匹配:每个任务必须由一名具备相应技能的员工完成。

时间窗口:某些任务有严格的开始和结束时间要求。

车辆和仓库容量:运输车辆和仓库的存储空间有限。

法规合规:员工工作时长、休息时间必须符合劳动法规。

与AIME这类有着确定答案的数学题不同,优化建模问题不仅需要我们找到最优解,更要输出对应的决策变量。除此之外,还有更深层次的挑战:

1、全局认知鸿沟:LLMs的生成特性使其倾向于局部、序列化的思考。但优化建模在处理海量变量和复杂约束时,需要建立一个完整的、全局的认知图谱,权衡所有变量之间的相互作用和影响。

2、隐形的巨大计算复杂度:尽管从问题理解角度看,建模与数学问题相似,但其求解阶段却隐藏着巨大的计算复杂性。以入门的线性规划为例,其求解算法(如单纯形法)在实际应用中通常表现出多项式时间复杂度(平均复杂度为O(n³))。这类计算密集型的求解过程,是LLMs难以直接胜任的。

这就是优化建模的起点,也是直接应用传统数学的RLVR难以胜任的地点。为了应对这些挑战,在先前ORLM工作的基础上,我们提出了一种结合运筹学建模与强化学习训练的创新方案, 该方案结合了数学思维链的推理能力与外部专业求解器的计算优势,旨在将LLMs的角色重新定义为“建模专家”。LLMs负责将自然语言问题转化为精确的数学模型,而高性能求解器(如COPT)则作为“烘焙师”,高效地完成求解任务,从而实现模型构建与计算求解的有效解耦。

求解器驱动的RLVR机制 融合数学建模与思维链推理

回顾我们大学数学建模或最优化课程,对于一个优化任务而言,解决一个现实世界的问题可以看成是一个多步骤的思维过程(CoTs, Chain-of-thoughts):

1、问题分析与推理:对问题描述进行剖析,以识别问题的核心信息,例如优化问题的类型和其关键组成部分。

2、数学建模:构建相对应的数学模型,这通常涉及参数集、目标函数和约束条件的定义。

3、算法求解: 生成相应的可执行代码,由优化求解器执行以得出目标值,决策变量和其他相关输出(如求解状态)。

在大模型时代,思维链(CoTs)已成为增强LLM处理复杂多步骤推理任务的基石。对应上述优化任务的解决过程,我们可将其视为由大模型执行与生成的、包含三个相互关联的步骤的思维链过程:问题分析、数学建模以及算法代码实现。

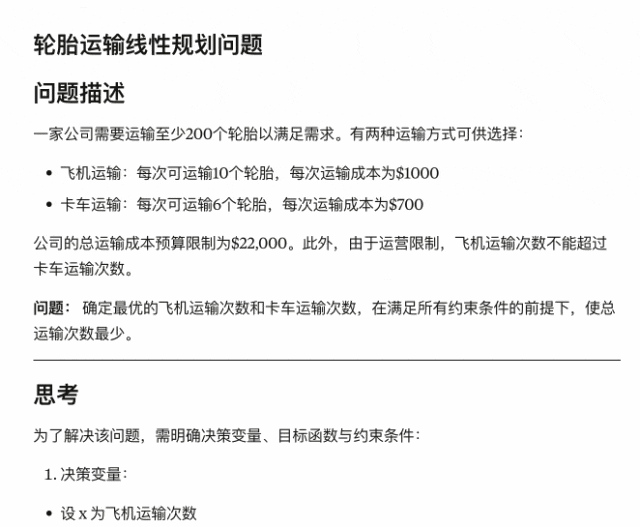

为了引导与规划大模型遵循这一范式,我们借鉴了DeepSeek-R1的训练机制,在系统提示词中明确规定了数学建模三步分析法,并要求模型在第三步中显式要求求解器作为其解题工具。一个具体的案例如下所示:

引导大模型遵循数学建模分析法

而这个LLMs执行后产生的多阶段输出,可以通过外部优化求解器(如COPT)进行多维度的验证:

确认生成代码的语法正确性。

判断数学模型的可行性,确保可以找到解决方案。

提供多维度的量化指标,如对于目标函数值(optimal value),可以与已知的最优解或基准方案进行比较。

这些由求解器提供的丰富、客观的输出信息,为RLVR提供了丰富的反馈信号。基于求解器定制的RLVR,我们能够直接训练大语言模型(LLMs),使其生成的解决方案不仅在语法上正确、可执行,更能提供高质量的求解路径。这为解决数学建模问题建立了一个强大的自我完善循环:LLM 产出的 CoTs(思维链) 推理,能通过专业求解器提供的可验证结果得到持续优化和提升。

求解器丰富的反馈信号

以上述提到的AIME数学类为例, 在应用可验证奖励强化学习(RLVR), 一个众所周知的挑战是奖励信号的稀疏性(sparsity of reward signal)。

如果仅依赖于简单的二元奖励, 如将求解器的最终目标值与最优值进行比较, 我们同样会遇到奖励信号的稀疏性这一问题。类似的,在应用RLVR对LLMs进行强化学习训练时,仅依赖上述稀疏的奖励信息, 我们无法为有缺陷的中间步骤提供足够的校正信号。

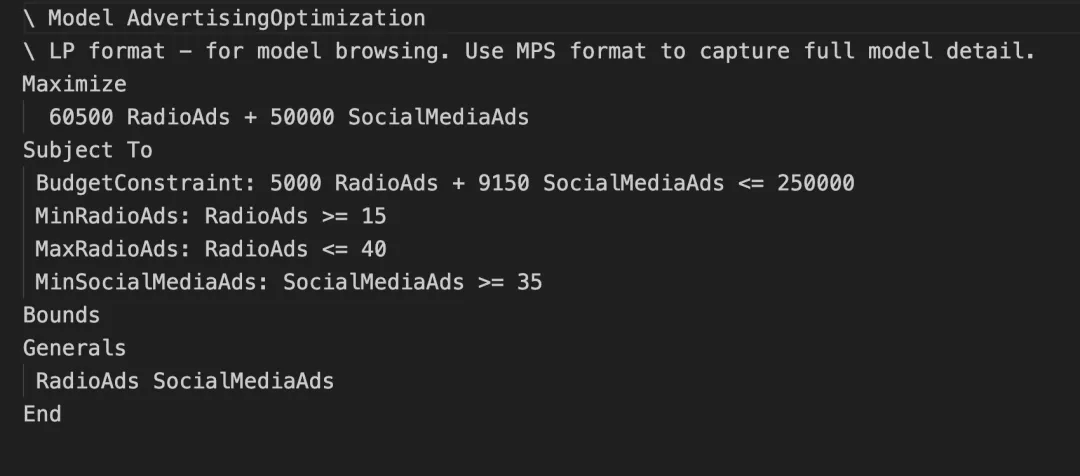

为了解决这一问题,我们基于优化求解器提供的丰富结构化信息,提出了一种创新的奖励机制。在成熟的求解器中,.lp文件是常用输出信息的一部分,对建模过程进行了表征,能够隐式反映LLMs的数学推理过程。我们即使无法得到问题的正确解,也还是可以从求解器输出的.lp文件看到:

求解器输出的 .lp 文件

这使我们能够设计出一种精细化的、过程感知的奖励。通过结合常用的求解器输出和 .lp 中信息的抽取,我们将结果式奖励的正确与过程式奖励的精细度刻画巧妙地结合起来,实现了从简单的“最终得分”到对“模型结构完整性”的奖励升级。在消融研究中,我们也进一步证实,这种协同组合是实现性能提升的关键。

选择性KL divergence

在对数学建模工程实现中,我们面临的另一个挑战则是:如何让模型既能天马行空地思考,又能严谨无误地执行。相应的,我们提出的Partial KL正解决了此问题,其核心理念是:在正确的阶段做正确的事。

在强化学习代理函数(Surrogate function)设计中,我们采用了Reinforce++的框架—Reinforce++提供了更细粒度token级的控制; 在这基础上,上述CoTs强化学习训练的生成过程划分成两个不同的阶段:

1、自由探索阶段(推理与分析):在模型的早期推理步骤中,我们完全移除KL散度惩罚, 鼓励模型如一位经验丰富的专家一样,去深入理解问题背景、发掘潜在约束、并探索多样化的解题思路。

2、严谨执行阶段(建模与代码):当模型进入数学建模和生成求解器代码这两个关键环节时,我们重新引入KL惩罚。这如同给工程师设定了严格的规范,确保生成的数学模型结构清晰、符合逻辑,并且求解器代码语法正确、格式规范。这保证了模型输出的稳定性和可执行性,有效避免了因过度探索而导致的策略崩塌。

这种分阶段、有选择性的惩罚机制,与传统的全局惩罚(如PPO)或全局无约束(DAPO)形成了鲜明对比。它既避免了对早期数学推理的压制,又确保了最终输出的质量,很好地平衡了数学思考的发散性与代码实现的严谨性。

模型结果表现

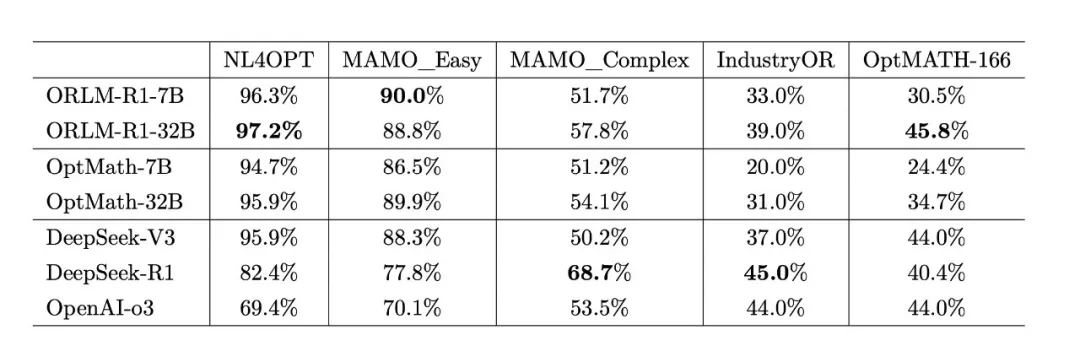

我们对通过上述方法训练的两个推理模型: ORLM-R1-7B 和 ORLM-R1-32B,在NL4OPT、MAMO_Easy、MAMO_Complex、IndustryOR 和 OptMATH 这几个数学建模基准数据集上进行了系统性评估。

在这些数据集上,我们发现我们的模型效果远超于之前其他论文所提出的离线微调方法和Agent-based方法。同时我们也和最先进的基座模型DeepSeek-V3, 大型推理模型DeepSeek-R1,OpenAI-o3进行比较,下面的图表展示了比较结果:

可以看到,我们的ORLM-R1-32B模型在平均性能上表现出色,优于DeepSeek-V3和OpenAI-o3,但在难度更大的任务上略逊于DeepSeek-R1。

另外一个有意思的现象,在简单的benchmark如NL4OPT和MAMO_Easy, 最强大的推理模型表现却不如我们的ORLM-R1-7B模型; 我们的初步分析验证了我们之前的结论,对于简单的数学建模,由于其与AIME数学题非常类似, 推理模型倾向于通过其擅长的一步步数学推理来解决,而非直接利用外部工具, 导致很多时候产生近似解。

局限性与未来工作

在ORLM-R1的研发中,我们对Deepseek-R1的推理机制在数学建模这一场景进行了拓展。通过工具调用,我们的32B推理模型ORLM-R1-32B在多个基准测试中,效果超越了Deepseek-V3和OpenAI-o3。然而,未来的工作仍面临着挑战:

benchmark的准确性

正如OpenAI研究员姚顺雨在其博客《The Second Half》中所言,AI上半场以基准测试成绩的不断攀升为标志。然而,在数学建模领域,我们面临一个严峻的挑战:即使是广为接受的基准数据集也或多或少存在错误。

在上述展示的benchmark结果中,我们对现有基准数据集进行了部分的校验与修正: 我们重点优化了 NL4OPT 和 IndustryOR 这两个侧重于实际场景的数据集,并修正了 MAMO_Complex 中旅行商问题(TSP)实例的错误,以形成更准确的标准化评估集。同时我们作为社区的一员,我们将继续致力于提供更精确的基准数据,并通过 GitHub 等方法向社区同步严格更正后的benchmark数据集。

但同时,修正所有benchmark里的问题或提供新的更高质量的benchmark数据需要整个社区的共同努力。

大模型建模的挑战

同时,上述benchmark结果也清晰展示了当前大模型建模的局限性,即使是最先进的模型如DeepSeek-R1,其在IndustryOR这类贴近实际业务场景的数据集上,准确率也未能超过50%。这与 LLMs 在数学类问题上普遍高达80%甚至90%的准确度形成了鲜明对比。这种差距不仅揭示了运筹学建模的固有难度,也表明当前LLMs在处理这类问题时存在根本性的局限。

而这,需要整个社区的共同努力,包括开发更先进的模型架构,也需要构建更高质量的基准数据集,并探索LLMs与专业求解器或其他工具协同工作的新范式。

大语言模型(LLMs)已经证明是优秀的数学家和奥数选手,通过可验证奖励强化学习(RLVR, reinforcement learning with verifiable reward)这类可提供即时、可验证反馈的自我迭代改进的训练方法,大语言模型在解决具有正确答案的传统数学问题(如AIME)方面表现得非常优异。

以最新版的DeepSeek-R1-0528模型为例,其在AIME 2025考试中获得了高达87.5%的正确率,相比其前代的70%准确率实现了巨大飞跃。这充分验证了大型推理模型(LRMs)与RLVR训练框架的显著优势——通过自我验证与渐进式推理优化,实现更精准的序列决策。